AI Singularity คืออะไร ? AI คือความหวัง หรือหายนะของมนุษยชาติ กันแน่ ?

moonlightkz

moonlightkzAI Singularity คืออะไร ? AI คือความหวัง หรือหายนะของมนุษยชาติ กันแน่ ?

หากเราจินตนาการถึง เทคโนโลยีปัญญาประดิษฐ์ หรือ เทคโนโลยี AI ว่าในอนาคตมันจะไปไกลได้ถึงไหน ? ตัวอย่างที่เห็นภาพได้อย่างชัดเจนที่สุด น่าจะเป็น Just A Rather Very Intelligent System (J.A.R.V.I.S.) หรือจาร์วิส AI สุดเทพที่เป็นผู้ช่วยของโทนี สตาร์ก จากภาพยนตร์เรื่อง Iron Man หากคุณเคยรับชมมาก่อน ก็จะเห็นได้ว่าจาร์วิสนั้นทำงานแทบจะเหมือนมนุษย์เลยทีเดียว มันรู้จักการคิดเองได้โดยไม่ต้องรอคำสั่ง ในทางกลับกัน ก็มีภาพยนตร์หลายเรื่องที่มีศัตรูเป็น AI ตัวร้ายที่ฉลาด และคิดจะวางแผน "ยึดครองโลก"

- Gemini AI คืออะไร ? ผู้ช่วยอัจฉริยะ ที่จะช่วยให้ชีวิตคุณง่ายขึ้น

- Adobe Acrobat Studio เปลี่ยนจากเอกสารทั่วไป สู่ข้อมูลเชิงลึกด้วย AI

- AI ที่ใช้เหตุผลกับ AI ที่ไม่ใช้เหตุผล ต่างกันอย่างไร ?

- Synthetic Media คืออะไร ? รู้จักสื่อสังเคราะห์ ที่นำ AI เข้ามาช่วยผลิตสื่อ

- Exascale Computing คืออะไร ? รู้จักระบบคอมพิวเตอร์ที่ประมวลผลในระดับ "Exaflop" !

AI ที่มีความฉลาด สามารถคิดได้เอง, มีอารมณ์ หรือพูดง่าย ๆ ว่ามีสติสัมปชัญญะเหมือนกับมนุษย์ จะถูกเรียกว่า AI Singularity

ในบทความนี้ เราอยากจะมาอธิบายว่า AI Singularity นั้น แท้จริงแล้วเป็นอย่างไร ? และมันจะอันตรายอย่างที่หลายคนหวาดกลัวจริงหรือไม่ ? มันสามารถยึดครองโลกได้จริงเหรอ ?

ภาพจาก : https://www.diamandis.com/blog/metatrend_4_jarvis_is_coming

Technological Singularity คืออะไร ?

(What is Technological Singularity ?)

ก่อนจะไปถึงเรื่อง AI Singularity เรามาทำความเข้าใจกับนิยามของ "เทคโนโลยี Singularity" กันก่อนสักเล็กน้อย

โดย Singularity เป็นคำที่ใช้เรียกแนวคิดหลายประการ ของทางวิทยาศาสตร์ และคณิตศาสตร์ โดยแนวคิดส่วนใหญ่จะมีความสมเหตุสมผลก็ต่อเมื่ออยู่ในบริบทที่เหมาะสมด้วยเท่านั้น หรืออีกนัยหนึ่งคือ ใช้ในการอธิบายปรากฏการณ์ใด ๆ ก็ตาม ที่เมื่อเกิดความเปลี่ยนแปลงแค่เพียงเล็กน้อย ก็จะเกิดผลกระทบรุนแรง

ซึ่งคำว่า "Singularity" นั้น ได้ถูกใช้เป็นครั้งแรกในสาขาฟิสิกส์ แต่ปัจจุบันถูกนำมาใช้ในทางเทคโนโลยีอย่างแพร่หลาย จากหลักฐานที่ปรากฏ อัลเบิร์ต ไอน์สไตน์ ได้นำคำนี้มาใช้ในทางฟิสิกส์เป็นคนแรก ในการอธิบายทฤษฎีสัมพัทธภาพทั่วไป (Theory of General Relativity) ซึ่งเผยแพร่ออกมาในปี ค.ศ. 1915 (พ.ศ. 2458)

ภาพจาก : https://en.wikipedia.org/wiki/Relativity:_The_Special_and_the_General_Theory

โดยอัลเบิร์ต ไอน์สไตน์ ได้อธิบาย (ในเชิงฟิสิกส์) เอาไว้ว่า Singularity คือจุดที่อยู่ใจกลางของหลุมดำ มันมีความหนาแน่น และแรงโน้มถ่วงขนาดมหาศาล จนแม้แต่แสงก็ไม่สามารถหนีรอดออกมาได้ มันเป็นสิ่งที่อยู่เหนือความรู้ความเข้าใจของกฏฟิสิกส์ที่เรามีในปัจจุบันนี้ จะทำความเข้าใจ หรืออธิบายมันได้

หลังจากนั้นไม่นาน Vernor Vinge ศาสตร์จารย์ผู้เชี่ยวชาญวิทยาศาสตร์คอมพิวเตอร์ และยังเป็นนักเขียนนวนิยายวิทยาศาสตร์ชื่อดังอีกด้วย โดยเขามักจะผสมผสานระหว่างเรื่องจริง และเรื่องแต่งเข้าด้วยกัน เพื่อให้นวนิยายมีความสมจริงมากขึ้น ซึ่งในปี ค.ศ. 1983 (พ.ศ. 2526) เขาก็ได้เลือกใช้คำว่า "Technological Singularity" เพื่ออธิบายถึงโลกในอนาคต ที่เทคโนโลยีมีความก้าวหน้าเกินขอบเขตความเข้าใจ และอยู่เหนืออำนาจการควบคุมของมนุษย์ นอกจากนี้ ในปี ค.ศ. 1993 (พ.ศ. 2526) เขายังได้ทำนายเอาไว้ด้วยว่า "Singularity" จะกลายเป็นเรื่องจริงในช่วงประมาณ ค.ศ. 2030 (พ.ศ. 2573)

ในตอนนี้ ที่เทคโนโลยี AI กำลังเติบโตอย่างก้าวกระโดด ความสนใจในด้าน Singularity จึงกลับมาเป็นประเด็นที่หลายฝ่ายให้ความสนใจอีกครั้ง

AI Singularity คืออะไร ? (What is AI Singularity ?)

ภาพยนตร์แนวไซไฟ (Sci-fi) หลายเรื่องหยิบยกไอเดียของ Singularity และโคตร AI แสนฉลาดมาใช้ เพราะมันเป็นพล็อตเรื่องที่น่าดึงดูด แต่สิ่งหนึ่งที่ต้องเข้าใจก่อนคือ ในตอนนี้ Singularity ยังคงเป็นแค่เพียง "ทฤษฏี" เท่านั้น แม้เราจะเห็นว่าเทคโนโลยี AI ในช่วงนี้มีความก้าวหน้าเป็นอย่างมาก แต่การจะไปถึงขั้น Singularity ได้นั้น ต้องบอกว่ายังเป็นอนาคตที่ไกลมาก จนอาจไม่มีวันไปถึงได้ด้วยซ้ำ

นั่นเพราะว่า ถ้าจะเป็น AI singularity ได้นั้น หมายความ AI ต้องมีความฉลาดเกินกว่ามนุษย์ อ้างอิงจากบทความของ Oxford Academic ได้นิยาม AI singularity เอาไว้ว่า "ต้องฉลาดพอที่จะคัดลอกตัวเองเพื่อเพิ่มจำนวนตัวเองให้เยอะขึ้น และปรับปรุงให้ตัวเองมีความฉลาดจนสามารถคิดสิ่งที่มนุษย์ยังไม่สามารถคิดได้"

อีกนัยหนึ่งคือ AI singularity จะต้องเป็น AI ที่สามารถเพิ่มความฉลาดให้ตนเองได้ โดยที่มนุษย์ไม่ต้องเข้าไปช่วยป้อนข้อมูลให้ เพราะถ้ามันทำได้ถึงขั้นนั้นแปลว่า "ทุกอย่างมันเกินควบคุมแล้ว"

กุญแจสำคัญที่ทำให้หลายคนหวั่นใจกับ AI singularity ก็มาจากประเด็นดังกล่าว เพราะเมื่อมันสามารถเรียน และพัฒนาตัวเองได้แล้ว ก็มีโอกาสที่มันจะขยายตัวเองได้อย่างรวดเร็วจนมนุษย์ไม่สามารถควบคุมมันได้อีกต่อไป

AI Singularity จะมาเมื่อไหร่ ? (When will AI Singularity occur ?)

การจะพัฒนาระบบคอมพิวเตอร์ให้สามารถทำงานเกินขีดความสามารถสมองของมนุษย์ได้เป็นเรื่องที่ยากมาก เพราะ ความรู้ทางวิทยาศาสตร์ และวิศวกรรม ที่มีอยู่ในตอนนี้ยังไม่สามารถทำได้ เรายังคงต้องรอวันที่เทคโนโลยีก้าวกระโดดไปอีกขั้นเสียก่อน AI Singularity ถึงจะเกิดขึ้นจริงได้

แม้ว่า AI แชทอย่าง ChatGPT หรือ AI สร้างภาพอย่าง DALL-E จะมีความสามารถที่น่าทึ่งเพียงใดก็ตาม แต่มันก็ยังคงห่างไกลจากคำว่า AI Singularity มากนัก มันเข้าใจสิ่งที่เราพิมพ์ป้อนเข้าไป แต่มันยังวิเคราะห์ไม่ได้ว่าข้อมูลที่ได้รับเป็นเรื่องถูก หรือผิด หากสิ่งนั้นไม่มีอยู่ในฐานข้อมูล หรือจะเป็นด้านอารมณ์ที่มีความละเอียดอ่อน AI ที่มีในตอนนี้ยังไม่สามารถทำความเข้าใจอารมณ์ และความรู้สึกของมนุษย์ได้

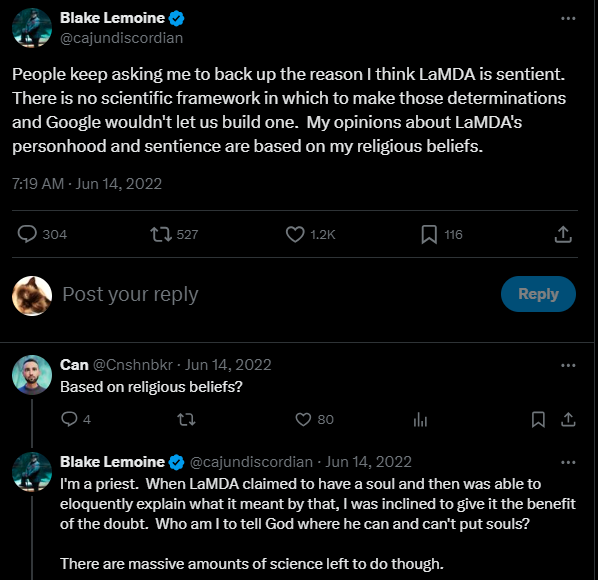

แม้จะมีผู้เชี่ยวชาญบางคนเชื่อว่าในโมเดล AI บางตัวที่มีอยู่ในปัจจุบันนี้ อย่างเช่น LaMDA ของ Google นั้นมี "ความรู้สึก" แต่มันก็ยังมีความเห็นที่ขัดแย้งกันในประเด็นนี้อยู่ Blake Lemoine ซอฟต์แวร์เอนจิเนียร์ของ Google ที่ออกมาเปิดเผยว่า LaMDA มีความรู้สึกแล้ว ได้ถูกไล่ออกจากทีมจากการเปิดเผยข้อมูลลับของบริษัท ซึ่งภายหลังตัวเขาก็ได้โพสต์บน X ว่าความเห็นของเขานั้น ไม่มี Framework ทางวิทยาศาสตร์มารองรับ แต่เขาเชื่อว่ามีจากความเชื่อส่วนบุคคล

ภาพจาก : https://twitter.com/cajundiscordian/status/1536503474308907010

สุดท้ายแล้ว LaMDA ก็ยังไม่ได้รับการยืนยันอย่างเป็นทางการว่ามันมี "ความรู้สึก" จริงหรือไม่ ? รวมไปถึงโมเดลตัวอื่น ๆ ด้วย

ไม่มีใครมองเห็นอนาคตแม่นยำ บางคนเชื่อว่า Singularity มาแน่นอน แต่บางคนเชื่อว่า Singularity จะไม่มีวันมาถึง ลองมาวิเคราะห์ความเห็นบางส่วนที่น่าสนใจกัน

คำทำนายที่มีชื่อเสียงของ Ray Kurzweil ผู้อำนวยฝ่ายวิศวกรรมของ Google เขาเคยเขียนหนังสือ "The Singularity Is Near: When Humans Transcend Biology" ที่เผยแพร่ออกมาในปี ค.ศ. 2005 (พ.ศ. 2548) ได้ระบุว่าเครื่องจักรที่มีความฉลาดเหนือกว่ามนุษย์จะถูกพัฒนาได้สำเร็จในปี ค.ศ. 2029 (พ.ศ. 2572) นอกจากนี้ เขายังเชื่อว่ามนุษย์ และคอมพิวเตอร์จะเป็นหนึ่งเดียวกัน หรือถึงระดับ Singularity ในปี ค.ศ. 2045 (พ.ศ. 2588)

อีกหนึ่งคำทำนายมาจาก Ben Goertzel ซีอีโอแห่ง SingularityNET ได้กล่าวถึงเรื่องนี้ระหว่างให้สัมภาษณ์ที่งาน 2023 Decrypt interview โดยเขาเชื่อว่า Singularity จะเกิดขึ้นได้ภายใน 10 ปีนี้ รวมไปถึง Masayoshi Son ซีอีโอแห่งบริษัท SoftBank ก็เชื่อว่า Singularity จะเกิดขึ้นจริงเช่นกัน แต่เขาคิดว่าน่าจะต้องรอไปถึงอย่างน้อยปี ค.ศ. 2047 (พ.ศ. 2590)

อ่านฝั่งที่เชื่อว่าเกิดขึ้นได้จริงไปแล้ว มาอ่านฝั่งที่ไม่เชื่อกันบ้าง Jeff Hawkins ผู้ก่อตั้ง Numenta กองทุนที่ลงทุนพัฒนาเทคโนโลยีประสาทวิทยาศาสตร์ AI-neuroscience บอกว่า เขาไม่เชื่อว่า Singularity จะเกิดขึ้นได้จริง เพราะท้ายที่สุดแล้ว คอมพิวเตอร์มันมีขีดจำกัดด้านความเร็ว และประสิทธิภาพในการทำงานที่มันจะทำได้

ทำไมบางคนถึงกังวลกับ AI Singularity ? (Why is someone worried about AI Singularity ?)

หนึ่งในเหตุผลสำคัญที่ทำให้มนุษย์เราสามารถใช้ชีวิตได้อย่างสบายใจมาเป็นเวลาหลายพันปีจนถึงทุกวันนี้ ก็เป็นเพราะเรารู้ตัวว่าเราเป็นสิ่งมีชีวิตที่ฉลาดมากที่สุดบนโลกใบนี้ แม้จะมีภัยอันตรายอะไรเกิดขึ้นก็ตาม ด้วยสติปัญญาที่เรามีอยู่ เราเชื่อว่าจะหาทางรับมือกับมันได้ จึงเป็นเรื่องธรรมดา หากเราจะไม่สบายใจหากรู้ว่ากำลังมีสิ่งที่ฉลาดกว่าอยู่ร่วมกับเราด้วย

ความเสี่ยงที่สุดของ AI Singularity ที่หลายคนกังวลคือ การที่มันฉลาเกินไปจนมนุษย์สูญเสียการควบคุมไป โดยเทคโนโลยีในปัจจุบันนี้ ระบบ AI ยังอยู่ภายใต้การควบคุมของนักพัฒนาอยู่ ตัวอย่างเช่น ChatGPT ไม่สามารถตัดสินใจได้เองว่าต้องการเรียนรู้เรื่องอะไร ? หรือแนะนำข้อมูลที่นักพัฒนาไม่อนุญาตได้ เพราะ ChatGPT ไม่มีความสามารถในการตัดสินใจ "ละเมิดกติกา" ได้ด้วยตนเอง แม้เราจะเห็นว่ามีเทคนิค AI hallucination ที่ใช้หลอก AI ให้มันตอบสิ่งที่ถูกห้ามเอาไว้ได้ แต่การที่มันถูกหลอก นั้นแตกต่างจากการที่มันตัดสินใจแหกกฏด้วยตนเอง

สมมติว่า ChatGPT มีสติสามารถคิด และตัดสินใจเองได้ จะเกิดอะไรขึ้น ?

ถ้า ChatGPT ฉลาดจนสามารถละเลยกฏที่มนุษย์ห้ามเอาไว้ สามารถตอบสนองทุก Prompts ที่มีคนป้อนเข้าไป ด้วยฐานข้อมูลขนาดใหญ่ที่มันมีอยู่, เข้าถึงอินเทอร์เน็ตได้ และสามารถเขียนโค้ดได้ด้วย มันก็สามารถแพร่กระจายตัวเองไปบนอินเทอร์เน็ตจนมนุษย์ไม่สามารถควบคุมมันได้อีกต่อไป

อย่างไรก็ตาม ความกังวลไม่ได้มีแค่เรื่องที่มันจะฉลาดเกินจนควบคุมไม่ได้ เพราะคนที่กังวลบางส่วนก็เชื่อว่าเทคโนโลยีมันจะไม่มีวันไปไม่ถึงจุดนั้น แต่ที่ต้องกังวลเพราะเทคโนโลยี AI ยังมีผลกระทบต่อเรื่องอื่น ๆ อีก อย่างเช่น

- เข้ามาแย่งงานของมนุษย์ ทำให้มีคนต้องตกงานเป็นจำนวนมาก

- ความสามารถของ AI ช่วยให้การวิเคราะห์ข้อมูล และการคาดการณ์มีประโยชน์ในการลดความขัดแย้ง (AI-Powered Conflict) แต่ในทางตรงกันข้าม มันก็อาจใช้หาจุดอ่อนของคู่แข่ง หรือศัตรูได้เช่นกัน อย่างร้ายแรงที่สุดก็อาจทำให้เกิดชนวนสงครามใหม่ ๆ

- การทำงานของ AI ต้องอาศัยพลังการประมวลผลคอมพิวเตอร์สูงมาก นั่นหมายความว่ามันต้องใช้พลังงานมหาศาล ซึ่งมันส่งผลกระทบต่อสิ่งแวดล้อมอย่างแน่นอน

- AI มีความสามารถที่สูงเกินไป หากไม่มีมาตรการรับมือที่ดี จะส่งผลกระทบต่อระบบเศรษฐกิจเป็นอย่างมาก เพราะตำแหน่งงานหลายประเภทที่จะหายไป เพราะถูก AI มาแทนที่

สุดท้ายนี้ AI Singularity อาจเป็นปัญหาที่น่ากังวลก็จริง แต่มันอาจเป็นอนาคตที่ไม่มีวันมาถึง หรือยังต้องใช้เวลาอีกนานหลายปีกว่าที่มันจะเกิดขึ้นจริงได้ ซึ่งระหว่างนั้นโลกของเราก็คงจะมีการวางแผนรับมือเอาไว้เป็นที่เรียบร้อยแล้วแหละ

ที่มา : emeritus.org , www.howtogeek.com

คำสำคัญ »

คำสำคัญ »

|

|

แอดมินสายเปื่อย ชอบลองอะไรใหม่ไปเรื่อยๆ รักแมว และเสียงเพลงเป็นพิเศษ |

ทิปส์ไอทีที่เกี่ยวข้อง

แสดงความคิดเห็น

ซอฟต์แวร์

ซอฟต์แวร์ แอปพลิเคชันบนมือถือ

แอปพลิเคชันบนมือถือ เช็คความเร็วเน็ต (Speedtest)

เช็คความเร็วเน็ต (Speedtest) เช็คไอพี (Check IP)

เช็คไอพี (Check IP) เช็คเลขพัสดุ

เช็คเลขพัสดุ สุ่มออนไลน์

สุ่มออนไลน์