Federated Learning คืออะไร ? แนวทางฝึก AI ที่ใส่ใจความเป็นส่วนตัวของข้อมูลผู้ใช้งาน

Federated Learning คืออะไร ? แนวทางฝึก AI ที่ใส่ใจความเป็นส่วนตัวของข้อมูลผู้ใช้งาน

เทคโนโลยีอย่างเช่น เทคโนโลยี AI ในปัจจุบัน กำลังมีบทบาทในชีวิตประจำวันของเราในหลาย ๆ เรื่อง ทุกคนเคยสงสัยกันบ้างไหมว่า "ข้อมูลของเรานั้นถูกนำเอาไปใช้ฝึก AI หรือเปล่า ?" ความกังวลเรื่องความเป็นส่วนตัวของข้อมูลผู้ใช้งาน กลายเป็นหัวข้อที่พูดถึงกันอย่างแพร่หลายในปัจจุบัน และซีเรียสมาก ๆ ในโซนยุโรป

ซึ่งนั่นเป็นผลให้ Federated Learning หรือ การเรียนรู้แบบกระจาย คือคำตอบของการพัฒนาเทคโนโลยีที่พยายามปรับสมดุลระหว่างการพัฒนา AI และรักษาความเป็นส่วนตัวของผู้ใช้งาน ซึ่งในบทความนี้จะพาทุกคนไปรู้จักกับ Federated Learning ว่ามันคืออะไร ? ทำงานอย่างไร ? และทำไมจึงสำคัญต่ออนาคตของ AI และความเป็นส่วนตัวของเรา ...

แนวทางดั้งเดิมของการฝึกฝน AI (Classical Machine Learning)

ก่อนที่เราจะเจาะลึกถึง Federated Learning เราควรเข้าใจก่อนว่า การเรียนรู้ของเครื่อง (Machine Learning) แบบดั้งเดิมนั้นมันทำงานอย่างไร โดยทั่วไปการฝึกโมเดล AI จำเป็นต้องใช้ ข้อมูล (Data) และ โมเดล (Model) ข้อมูลจะถูกใช้ในการปรับปรุงโมเดล เพื่อให้สามารถทำงานบางอย่างได้ เช่น เอาไป วิเคราะห์ภาพ (Image Recognition), ถอดเสียง หรือคาดการณ์เหตุการณ์ต่าง ๆ

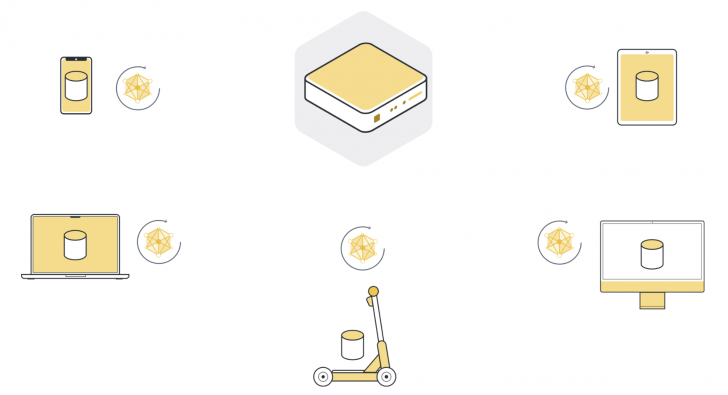

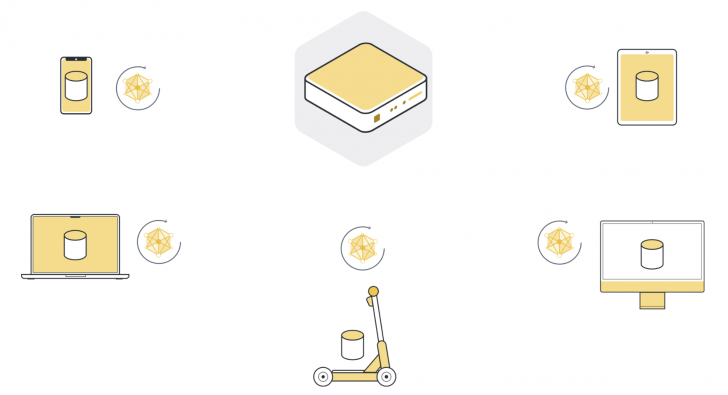

ภาพจาก : https://flower.ai/docs/framework/tutorial-series-what-is-federated-learning.html

ข้อมูลเหล่านี้มักไม่ได้ถูกสร้างบนเครื่องที่ใช้ฝึกโมเดล แต่เกิดขึ้นในอุปกรณ์ที่มากมาย ไม่ว่าจะเป็นสมาร์ทโฟน เซนเซอร์ในอุปกรณ์ต่าง ๆ หรือ อุปกรณ์ IoT หลายตัว ข้อมูลทั้งหมดจะถูกส่งไปยัง เซิร์ฟเวอร์กลาง (Centralized Server) เพื่อจัดเก็บ และประมวลผลร่วมกัน ซึ่งเป็นวิธีที่ Machine Learning ใช้มาอย่างยาวนานตั้งแต่แรกเริ่ม

ข้อจำกัดของ Classical Machine Learning

แม้ว่าการรวบรวมข้อมูลไว้ที่ศูนย์กลางจะเหมาะกับบางกรณี แต่แนวทางนี้ก็ยังมีข้อจำกัดอยู่

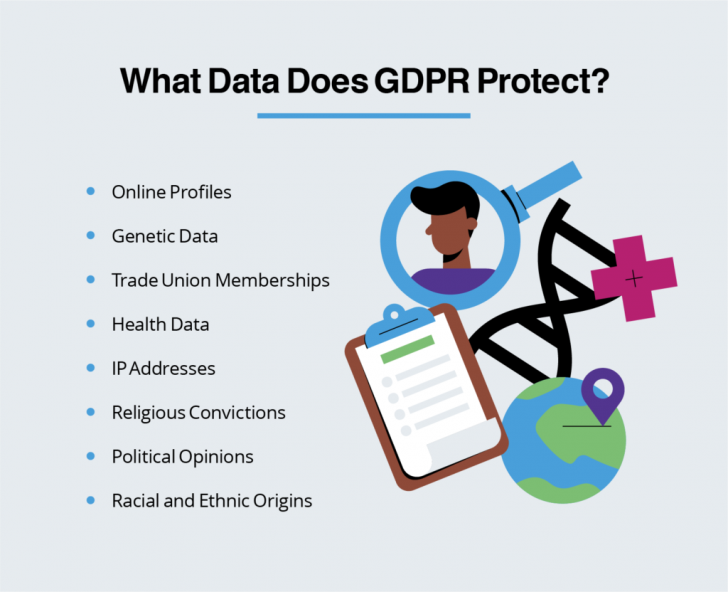

- กฎหมายคุ้มครองข้อมูล : หลายประเทศมีกฎหมายเข้มงวด เช่น GDPR (ยุโรป) ที่จำกัดการย้ายข้อมูลผู้ใช้งานข้ามพรมแดน คุ้มครองข้อมูลผู้ใช้งาน โซเชียลมีเดีย (Social Media)

- ความคาดหวังของผู้ใช้งาน : ผู้ใช้งานหลายคนต้องการให้ข้อมูลส่วนตัว เช่น รหัสผ่าน หรือข้อมูลสุขภาพ ยังคงอยู่ในอุปกรณ์ของตนเองไม่แพร่ออกไปแหล่งอื่น

- ปริมาณข้อมูลมหาศาล : ในบางกรณี ตัวอย่างเช่น กล้องวงจรปิด หรือเซนเซอร์ ข้อมูลที่เกิดขึ้นนั้นมีปริมาณมาก เกินกว่าที่จะรวบรวมแล้วส่งไปยังเซิร์ฟเวอร์กลางได้

ตัวอย่างที่วิธีเดิมไม่ตอบโจทย์

ด้วยจำนวนข้อมูลที่มหาศาลอย่าง ข้อมูลสุขภาพจากโรงพยาบาลหลายแห่งที่ต้องใช้ในการฝึกโมเดลตรวจโรค, ข้อมูลการเงินจากองค์กรหลายแห่งสำหรับวิเคราะห์การฉ้อโกง, ข้อมูลการเดินทางของรถยนต์ไฟฟ้าสำหรับคาดการณ์ระยะทาง การที่จะส่งกลับไปยังศูนย์กลางแล้วเอามาฝึกโมเดล แล้วค่อยส่งกลับนั้น เป็นวิธีการที่ไม่ตอบโจทย์อย่างมาก ด้วยข้อจำกัดเหล่านี้ แนวทางการเรียนรู้แบบรวมศูนย์ จึงไม่เหมาะสมในหลายงาน และนั่นเป็นที่มาของการพัฒนา Federated Learning ซึ่งช่วยตอบโจทย์ปัญหาเหล่านี้นั่นเอง

ภาพจาก : https://velocityglobal.com/resources/blog/what-is-gdpr-compliance/

Federated Learning คืออะไร ? (What is Federated Learning ?)

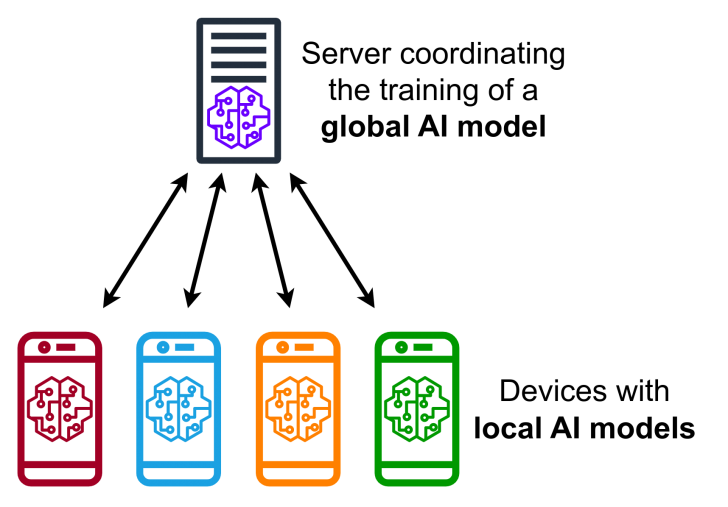

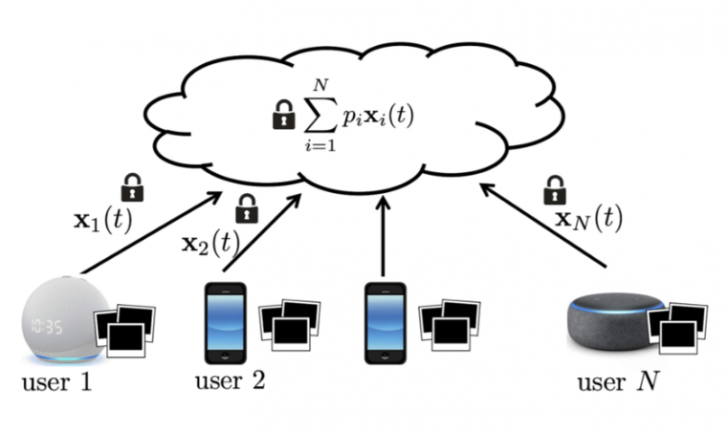

Federated Learning หรือที่เรียกว่า "การเรียนรู้แบบกระจาย" ก็คือวิธีการฝึกโมเดล AI ที่ช่วยให้หลายอุปกรณ์ หรือหลายฝ่าย (Client) สามารถร่วมกันพัฒนาโมเดล AI ได้ โดยที่ข้อมูลทั้งหมดจะยังคงอยู่ในอุปกรณ์ หรือระบบของแต่ละฝ่าย แทนที่จะต้องส่งข้อมูลเหล่านั้นไปยังเซิร์ฟเวอร์กลางนั่นเอง

หลักการสำคัญของ Federated Learning คือการ "นำกระบวนการฝึกโมเดลไปหาข้อมูล" แทนที่จะ "นำข้อมูลไปฝึกโมเดล" โมเดล AI จะถูกส่งไปยังอุปกรณ์ หรือเซิร์ฟเวอร์ของผู้ใช้งาน จากนั้นจะใช้ข้อมูลในอุปกรณ์นั้นฝึกโมเดล และส่งผลลัพธ์ เช่น เอาไปอัปเดตพารามิเตอร์ของโมเดล หรือก็คือค่าที่คำนวณออกมาเรียบร้อยแล้ว กลับมายังเซิร์ฟเวอร์กลาง โดยไม่เคยนำข้อมูลฝึกที่เป็นส่วนตัวออกจากอุปกรณ์เลย

ภาพจาก : https://en.wikipedia.org/wiki/Federated_learning#/media/File:Centralized_federated_learning_protocol.png

วิธีการนี้เหมาะสำหรับการใช้งานที่ต้องการความเป็นส่วนตัวสูง เช่น ประมวลผลข้อมูลส่วนบุคคลบนสมาร์ทโฟน, ข้อมูลการเงิน หรือข้อมูลสุขภาพ อีกทั้งยังตอบโจทย์ในสถานการณ์ที่ข้อมูลมีปริมาณมากกระจัดกระจาย หรือข้อมูลที่สร้างโดยผู้ใช้งานในสถานที่ต่าง ๆ

Federated Learning ทำงานอย่างไร ? (How does Federated Learning work ?)

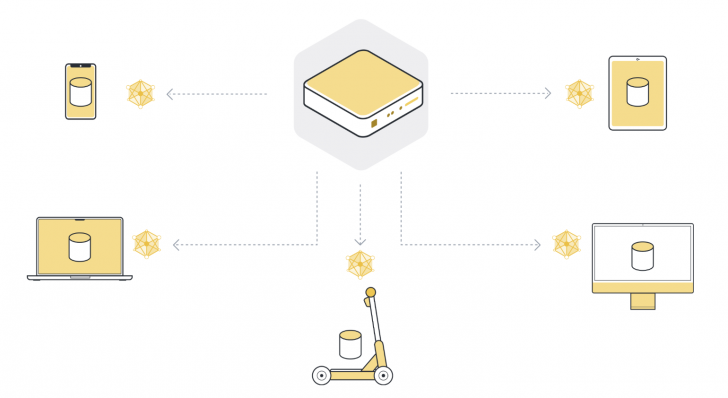

การทำงานของ Federated Learning เป็นกระบวนการที่แบ่งออกเป็นหลายขั้นตอน โดยมีการแลกเปลี่ยนข้อมูลระหว่างเซิร์ฟเวอร์กลาง และอุปกรณ์ลูกข่าย หรือไคลเอนต์ (Client) ภาพรวมของขั้นตอนการทำงานก็จะมีดังนี้เลย

1. เริ่มต้นด้วยการสร้างโมเดลหลัก (Initialize Global Model)

กระบวนการเริ่มต้นจากการสร้างโมเดลพื้นฐานบนเซิร์ฟเวอร์กลาง โมเดลนี้อาจถูกตั้งค่าแบบสุ่ม หรือใช้ค่าเริ่มต้นจากโมเดลที่เคยถูกฝึกมาก่อนในงานที่ใกล้เคียงกัน

2. ส่งโมเดลไปยังไคลเอนต์ที่เลือก (Send Model to Clients)

เซิร์ฟเวอร์จะส่งพารามิเตอร์ของโมเดลหลัก (เช่น ค่าน้ำหนัก หรือค่าอคติของโมเดล) ไปยังอุปกรณ์ไคลเอนต์ที่เข้าร่วมการฝึก ซึ่งอุปกรณ์เหล่านี้อาจเป็นสมาร์ทโฟน, เซนเซอร์ หรือเซิร์ฟเวอร์ขององค์กร ในแต่ละรอบของการฝึก โมเดลจะถูกส่งไปยังไคลเอนต์ที่ถูกเลือกจำนวนหนึ่ง (ไม่จำเป็นต้องใช้ทุกไคลเอนต์พร้อมกัน) เพื่อความรวดเร็ว และลดภาระการประมวลผล

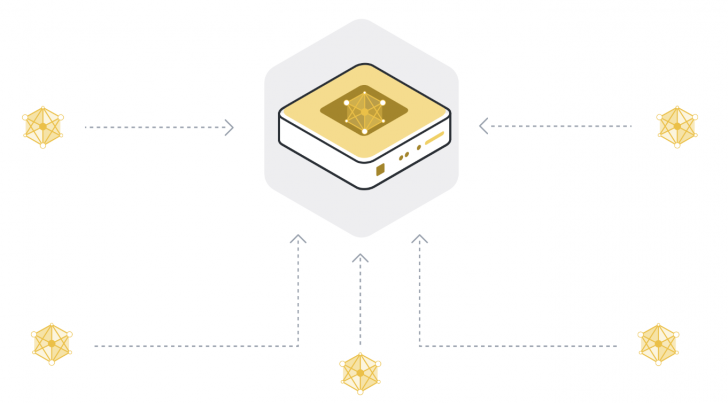

ภาพจาก : https://flower.ai/docs/framework/tutorial-series-what-is-federated-learning.html

หลังจากที่ไคลเอนต์ทำการอัปเดตโมเดลด้วยข้อมูลเฉพาะของตัวเองแล้ว จะส่งพารามิเตอร์ที่อัปเดตกลับไปยังเซิร์ฟเวอร์ ซึ่งเซิร์ฟเวอร์จะรวมพารามิเตอร์จากไคลเอนต์หลายตัวเพื่ออัปเดตโมเดลหลักต่อไป

3. ฝึกโมเดลภายในอุปกรณ์ (Train Model Locally)

อุปกรณ์ไคลเอนต์จะใช้ข้อมูลของตัวเองในการฝึกโมเดล การฝึกจะดำเนินไปเพียงระยะเวลาสั้น ๆ รันหนึ่งรอบข้อมูล หรือไม่กี่ขั้นตอนการอัปเดตพารามิเตอร์ เพื่อให้ได้ผลลัพธ์เบื้องต้น ที่สะท้อนลักษณะของข้อมูลในอุปกรณ์นั้น

ภาพจาก : https://flower.ai/docs/framework/tutorial-series-what-is-federated-learning.html

4. ส่งการอัปเดตโมเดลกลับไปยังเซิร์ฟเวอร์ (Send Model Updates to Server)

เมื่อการฝึกในแต่ละอุปกรณ์เสร็จสิ้น ผลลัพธ์ที่ได้ ซึ่งมักเป็นค่าพารามิเตอร์ที่ถูกปรับปรุงใหม่ หรือค่าความเปลี่ยนแปลงของพารามิเตอร์ จะถูกส่งกลับมายังเซิร์ฟเวอร์กลาง

ภาพจาก : https://flower.ai/docs/framework/tutorial-series-what-is-federated-learning.html

5. รวมผลลัพธ์เพื่อสร้างโมเดลใหม่ (Aggregate Model Updates)

เซิร์ฟเวอร์จะรวบรวมการอัปเดตจากอุปกรณ์ทั้งหมดที่เข้าร่วม และใช้เทคนิคที่เรียกว่า Federated Averaging (FedAvg) เพื่อปรับปรุงโมเดลหลัก โดยการเฉลี่ยผลลัพธ์เหล่านี้ตามน้ำหนัก ก็คือจำนวนตัวอย่างข้อมูลที่อุปกรณ์แต่ละเครื่องใช้ในการฝึกนั่นเอง

6. ทำซ้ำกระบวนการจนกว่าจะแม่นยำ (Repeat Until Convergence)

หลังจากการปรับปรุงโมเดลใหม่ในแต่ละรอบ กระบวนการทั้งหมด ตั้งแต่การส่งโมเดลไปยังไคลเอนต์ ไปจนถึงการรวมผลลัพธ์ จะถูกทำซ้ำหลายรอบ จนกว่าโมเดลจะมีประสิทธิภาพเพียงพอ และสามารถทำงานได้ดีบนข้อมูลจากทุกไคลเอนต์

Federated Learning คือการปรับสมดุลระหว่างการฝึกโมเดล และการคงไว้ซึ่งความเป็นส่วนตัว ข้อมูลของผู้ใช้งานไม่เคยออกจากอุปกรณ์ ในขณะที่เซิร์ฟเวอร์กลางสามารถรวบรวมความรู้จากข้อมูลที่กระจัดกระจายมาพัฒนาโมเดลให้ดีขึ้นได้ กระบวนการนี้ไม่เพียงช่วยแก้ปัญหาด้านความเป็นส่วนตัว แต่ยังทำให้ AI มีความสามารถในการเรียนรู้จากข้อมูลที่หลากหลายได้มากขึ้นนั่นเอง

ข้อได้เปรียบของ Federated Learning (Advantages of Federated Learning)

1. รักษาความเป็นส่วนตัวของข้อมูล

ข้อมูลใน Federated Learning จะยังคงอยู่ในแหล่งกำเนิด บน สมาร์ทโฟน, เซิร์ฟเวอร์องค์กร หรืออุปกรณ์ IoT โดยไม่ต้องถูกส่งไปยังเซิร์ฟเวอร์กลาง วิธีนี้ช่วยลดความเสี่ยงที่ข้อมูลจะรั่วไหล ถูกแฮ็ก หรือถูกนำไปใช้อย่างไม่เหมาะสม

2. การทำงานร่วมกันในอุตสาหกรรมที่มีข้อจำกัดสูง

ในหลายอุตสาหกรรม เช่น การแพทย์ และการเงิน การแบ่งปันข้อมูลมักถูกจำกัดด้วยกฎหมาย และข้อบังคับ เช่น GDPR หรือ HIPAA ซึ่ง Federated Learning ช่วยให้หลายองค์กรสามารถร่วมกันฝึกโมเดล AI ได้ โดยไม่ต้องแชร์ข้อมูลที่เป็นความลับ

3. จัดการข้อมูลที่กระจัดกระจาย

ปัจจุบันข้อมูลจำนวนมหาศาลกระจายตัวอยู่ในหลายอุปกรณ์ Federated Learning ช่วยให้ AI สามารถเข้าถึงข้อมูลเหล่านี้ได้โดยไม่ต้องรวบรวมข้อมูลทั้งหมดไว้ที่ศูนย์กลาง

4. การปรับปรุงโมเดลด้วยข้อมูลจริงในบริบทที่หลากหลาย

เนื่องจากข้อมูลจากแต่ละแหล่งมีความหลากหลาย Federated Learning ช่วยให้โมเดลเรียนรู้จากข้อมูลที่สะท้อนถึงสถานการณ์จริงของผู้ใช้งาน เช่น เอาไป ปรับปรุงโมเดลแนะนำสินค้าออนไลน์โดยใช้ข้อมูลจากผู้ใช้งานในแต่ละพื้นที่

5. ลดข้อจำกัดทางเทคโนโลยี และทรัพยากร

การประมวลผลในอุปกรณ์ของผู้ใช้งานช่วยลดความจำเป็นในการสร้าง ศูนย์ข้อมูล หรือ ดาต้าเซ็นเตอร์ (Data Center) ขนาดใหญ่ และลดค่าใช้จ่ายในการส่งข้อมูลปริมาณมหาศาลเข้าสู่เซิร์ฟเวอร์

6. การพัฒนา AI ที่เป็นมิตรต่อกฎระเบียบ และความคาดหวังของผู้ใช้งาน

Federated Learning ช่วยสร้างความสมดุลระหว่างประสิทธิภาพของ AI และการปฏิบัติตามข้อกำหนดด้านกฎหมาย ขณะเดียวกันยังตอบสนองความคาดหวังของผู้ใช้งานที่ต้องการให้ข้อมูลส่วนตัวไม่ถูกเปิดเผย

ความท้าทาย และข้อจำกัด ของ Federated Learning (Challenges and Limitations of Federated Learning)

แม้ว่า Federated Learning จะมีข้อดีมากมายในการพัฒนา AI และรักษาความเป็นส่วนตัวของข้อมูล แต่ก็ยังมีข้อจำกัด และความท้าทายหลายประการที่ต้องแก้ไขเพื่อให้ใช้งานได้อย่างเต็มประสิทธิภาพ

1. ข้อจำกัดด้านทรัพยากร และประสิทธิภาพ (Resource and Efficiency Constraints)

การฝึกโมเดล AI แบบกระจายตัว ต้องการพลังประมวลผลสูง และการสื่อสารที่รวดเร็ว อุปกรณ์ที่มีข้อจำกัดด้านทรัพยากร อาจทำให้การประมวลผลล่าช้า หรือใช้พลังงานมากเกินไป นอกจากนี้ การส่งข้อมูลอัปเดตโมเดลระหว่างเซิร์ฟเวอร์ และอุปกรณ์ยังต้องใช้แบนด์วิดท์สูง ซึ่งอาจเป็นปัญหาในสถานการณ์ที่เครือข่ายมีข้อจำกัด

2. ความโปร่งใส และความเป็นธรรม (Transparency and Fairness)

เนื่องจากข้อมูลของแต่ละไคลเอนต์ไม่ได้ถูกเปิดเผย การตรวจสอบความถูกต้อง, ความยุติธรรม และการลดอคติในผลลัพธ์ของโมเดลจึงเป็นเรื่องที่ซับซ้อน การขาดความโปร่งใสอาจนำไปสู่ความยากลำบากในการตรวจสอบว่าข้อมูลจากแต่ละฝ่ายถูกใช้ในลักษณะที่ถูกต้องหรือไม่

3. การจัดการข้อมูลที่ลบออก (Data Removal Management)

เมื่อไคลเอนต์ออกจากระบบ หรือถอนตัวจากกระบวนการฝึก Federated Learning อาจต้องเผชิญกับความท้าทายในการลบข้อมูลของไคลเอนต์นั้นออกจากโมเดลกลาง การลบข้อมูลอย่างสมบูรณ์อาจต้องเริ่มกระบวนการฝึกใหม่ทั้งหมด ซึ่งต้องใช้ทรัพยากร และเวลาอย่างมาก นักวิจัยกำลังพัฒนาแนวทางที่ช่วยให้สามารถลบอิทธิพลของข้อมูลบางส่วนได้โดยไม่ต้องฝึกโมเดลใหม่จากศูนย์

4. ความเชื่อมั่น และความน่าเชื่อถือระหว่างไคลเอนต์ (Trust and Data Integrity)

ในระบบที่มีผู้ใช้งาน หรือองค์กรหลายฝ่าย ความเชื่อมั่นระหว่างกันเป็นสิ่งสำคัญ เพราะบางฝ่ายอาจใส่ข้อมูลที่ไม่ถูกต้อง หรือข้อมูลปลอมเข้ามาเพื่อบิดเบือนผลลัพธ์ของโมเดล Federated Learning ยังต้องการระบบที่สามารถสร้างแรงจูงใจให้ทุกฝ่ายส่งข้อมูลที่ถูกต้อง และเป็นประโยชน์

5. การรวมข้อมูลที่แตกต่างกัน (Heterogeneous Data Integration)

ใน Federated Learning ข้อมูลจากแต่ละไคลเอนต์อาจมีลักษณะที่แตกต่างกันมาก เช่น ปริมาณ, รูปแบบ, หรือการกระจายตัว ทำให้โมเดลต้องเผชิญกับความท้าทายในการปรับตัวให้เข้ากับข้อมูลที่หลากหลาย ซึ่งอาจส่งผลต่อความแม่นยำของผลลัพธ์

6. ความปลอดภัย และการป้องกันการรั่วไหลของข้อมูล (Security and Privacy Risks)

ถึงแม้ Federated Learning จะช่วยลดความเสี่ยงจากการแชร์ข้อมูลโดยตรง แต่ก็ยังมีโอกาสที่ข้อมูลจะถูกโจมตีผ่านการวิเคราะห์โมเดลที่ถูกส่งกลับไปยังเซิร์ฟเวอร์ การป้องกันการรั่วไหล และการโจมตีแบบเจาะข้อมูลยังคงเป็นหัวข้อวิจัยสำคัญ ไม่ว่าจะเป็นการใช้เทคนิค Differential Privacy หรือ Secure Multi-Party Computation เพื่อเพิ่มความปลอดภัย การพัฒนาเทคนิค และเครื่องมือใหม่ ๆ อย่างต่อเนื่องกำลังช่วยลดผลกระทบเหล่านี้

ความท้าทาย และข้อจำกัด ของ Federated Learning (Challenges and Limitations of Federated Learning)

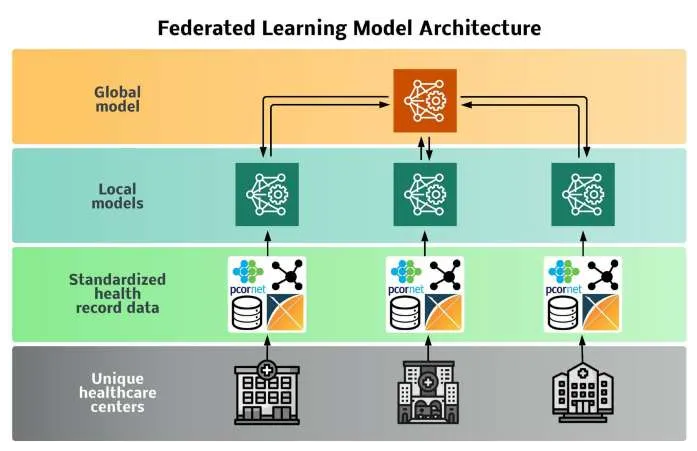

การแพทย์

ในวงการแพทย์ การปกป้องข้อมูลส่วนตัวของผู้ป่วยเป็นสิ่งสำคัญยิ่ง โรงพยาบาลสามารถใช้ Federated Learning เพื่อฝึกโมเดล AI ที่มีความแม่นยำในการตรวจจับโรคร้ายแรง เช่น มะเร็ง โดยไม่จำเป็นต้องแชร์ข้อมูลส่วนตัวของผู้ป่วยระหว่างโรงพยาบาล สิ่งนี้ช่วยลดความเสี่ยงในการรั่วไหลของข้อมูล และยังคงความปลอดภัยของผู้ป่วยได้อย่างเต็มที่

ภาพจาก : https://medium.com/@cloudhacks_/federated-learning-a-paradigm-shift-in-data-privacy-and-model-training-a41519c5fd7e

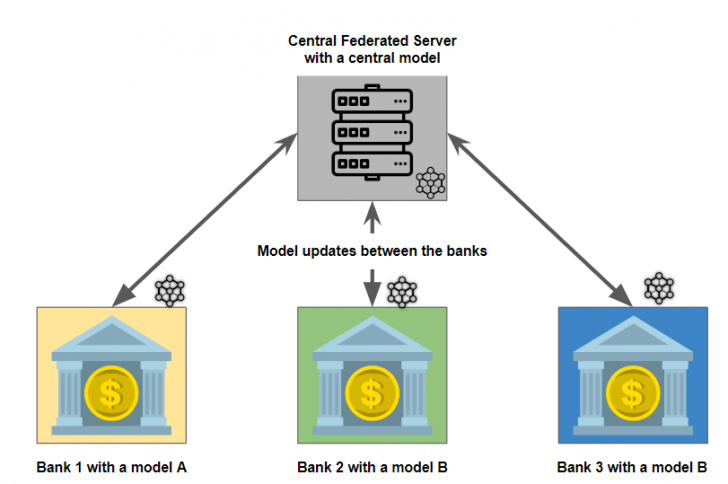

การเงิน

ธนาคาร และสถาบันการเงินสามารถนำ Federated Learning มาใช้พัฒนาโมเดล AI ที่สามารถตรวจจับการฉ้อโกงทางการเงิน หรือประเมินเครดิตได้ โดยไม่ละเมิดความเป็นส่วนตัวของลูกค้า โมเดลเหล่านี้สามารถเรียนรู้จากข้อมูลที่กระจัดกระจายอยู่ในหลายสาขา หรือหลายองค์กรได้อย่างปลอดภัย ช่วยลดความเสี่ยงต่อการละเมิดข้อมูลทางการเงิน

ภาพจาก : https://medium.datadriveninvestor.com/federated-learning-use-cases-in-finance-ed26fe788da7

เทคโนโลยี IoT

ในอุตสาหกรรมที่เกี่ยวข้องกับอุปกรณ์ IoT และสมาร์ทโฟน Federated Learning ช่วยให้อุปกรณ์เหล่านี้สามารถพัฒนา AI สำหรับการคาดการณ์ เช่น การบริหารการใช้พลังงานหรือการบำรุงรักษาเครื่องจักรล่วงหน้า โดยข้อมูลที่ใช้เรียนรู้นั้นจะถูกประมวลผลในแต่ละอุปกรณ์ แทนที่จะส่งข้อมูลทั้งหมดไปยังเซิร์ฟเวอร์กลาง

ภาพจาก : https://www.researchgate.net/figure/Federated-Learning-for-IoT-Devices_fig1_356249953

บทสรุป : อนาคตของ Federated Learning ในการพัฒนา AI (Conclusion : The Future of Federated Learning in AI Development)

Federated Learning มีศักยภาพสูงที่จะกลายเป็นรากฐานสำคัญของระบบ AI ในอนาคต โดยเฉพาะในยุคนี้ที่ความเป็นส่วนตัวของผู้ใช้งานกลายเป็นเรื่องสำคัญที่สุด อุตสาหกรรมที่พึ่งพาข้อมูลส่วนตัว ล้วนสามารถนำ Federated Learning ไปประยุกต์ใช้งานเพื่อเพิ่มประสิทธิภาพวิเคราะห์ และพัฒนานวัตกรรมได้ แม้จะยังมีข้อจำกัดอยู่บ้างไม่ว่าจะจัดการยาก และมีความล่าช้าเพราะ Client มาก แต่ด้วยเทคโนโลยีที่ค่อย ๆ เพิ่มขึ้นในปัจจุบันก็สามารถเอาชนะได้ไม่ยาก

ในอนาคต เราอาจได้เห็น Federated Learning ถูกนำมาใช้ในมิติใหม่ ๆ เช่นพัฒนา AI เพื่อแก้ปัญหาโลกร้อน, วางแผนระบบเมืองอัจฉริยะ, การศึกษาเฉพาะบุคคล (Personalized Education) และการสร้างระบบดูแลสุขภาพเฉพาะบุคคล (Personalized Healthcare) โดยยังคงให้ความสำคัญกับความเป็นส่วนตัว และความปลอดภัยของผู้ใช้งานอยู่นั่นเอง

ที่มา : research.ibm.com , en.wikipedia.org , flower.ai

คำสำคัญ »

คำสำคัญ »

|

|

ทิปส์ไอทีที่เกี่ยวข้อง

แสดงความคิดเห็น

ซอฟต์แวร์

ซอฟต์แวร์ แอปพลิเคชันบนมือถือ

แอปพลิเคชันบนมือถือ เช็คความเร็วเน็ต (Speedtest)

เช็คความเร็วเน็ต (Speedtest) เช็คไอพี (Check IP)

เช็คไอพี (Check IP) เช็คเลขพัสดุ

เช็คเลขพัสดุ สุ่มออนไลน์

สุ่มออนไลน์