DALL-E คืออะไร ? รู้จัก AI สร้างภาพ ที่เปลี่ยนจินตนาการเป็นรูปภาพได้ !

DALL-E คืออะไร ? รู้จัก AI ที่เปลี่ยนจินตนาการเป็นภาพได้ !

ในยุคที่เทคโนโลยี ปัญญาประดิษฐ์ (AI) ก้าวล้ำไปไกลจนเกินกว่าที่เราจะจินตนาการได้ และไม่นานมานี้ DALL-E ก็ได้กลายเป็นหนึ่งในนวัตกรรมที่น่าทึ่ง และถูกจับตามอง เราสามารถใช้มันเปลี่ยนคำพูด ให้กลายเป็นภาพที่สมจริงได้อย่างง่ายดาย ไม่ว่าจะนึกถึงภาพของหุ่นยนต์ในสวนดอกไม้ หรือที่เป็นเทรนด์หนักเช่นแมวที่สวมเสื้อใช้ชีวิตเหมือนกับคน DALL-E ก็สามารถสร้างสรรค์ภาพเหล่านั้นออกมาได้อย่างที่จินตนาการไว้ !

- Adobe Acrobat Studio เปลี่ยนจากเอกสารทั่วไป สู่ข้อมูลเชิงลึกด้วย AI

- AI ที่ใช้เหตุผลกับ AI ที่ไม่ใช้เหตุผล ต่างกันอย่างไร ?

- Synthetic Media คืออะไร ? รู้จักสื่อสังเคราะห์ ที่นำ AI เข้ามาช่วยผลิตสื่อ

- Exascale Computing คืออะไร ? รู้จักระบบคอมพิวเตอร์ที่ประมวลผลในระดับ "Exaflop" !

- Optical Computing คืออะไร ? จะเป็นอย่างไรหากคอมพิวเตอร์ใช้แสงแทนกระแสไฟฟ้า

และบทความนี้จะพาทุกคนไปรู้จักกับเทคโนโลยีสุดล้ำ DALL-E ที่ผสมผสาน การเรียนรู้เชิงลึก (Deep Lerning) เข้ากับความสามารถทางศิลปะ ทั้งความหมาย, ความเป็นมา, หลักการทำงาน, ข้อดี และข้อสังเกต รวมถึงการนำไปใช้ประโยชน์ของ DALL-E ที่สร้างความเป็นไปได้ใหม่ ๆ ให้กับทั้งนักออกแบบ, ศิลปิน และผู้ใช้ทั่วไป เรามาเริ่มกันเลย !

DALL-E คืออะไร ? (What is DALL-E ?)

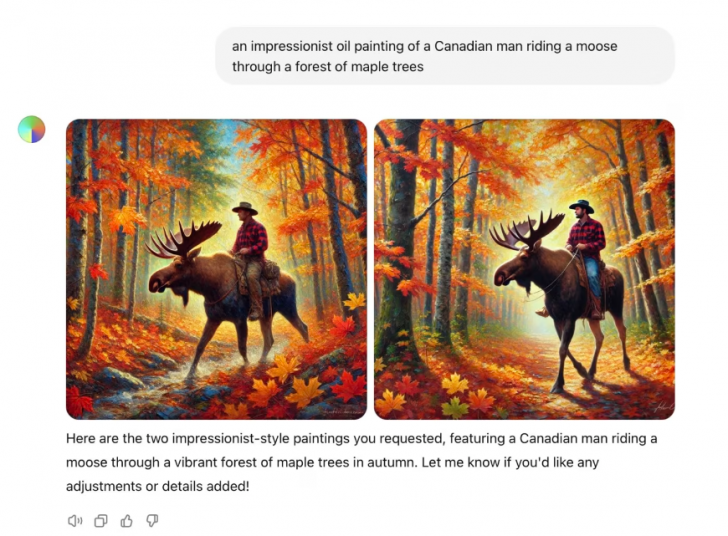

DALL-E คือเทคโนโลยีปัญญาประดิษฐ์ (AI) สุดล้ำ ที่สร้างภาพจากข้อความ หรือคำสั่งของผู้ใช้งาน เจ้าเทคโนโลยีนี้พัฒนาขึ้นโดย OpenAI และเปิดตัวครั้งแรกในปี ค.ศ. 2021 (พ.ศ. 2564) โดยใช้การเรียนรู้เชิงลึกจากโมเดล GPT-3 ทำให้สามารถเข้าใจข้อความที่ซับซ้อน และแปลงเป็นภาพที่มีรายละเอียดตามจินตนาการได้ เช่น ภาพของแมวที่นำมาใส่ชุดต่าง ๆ จนกลายเป็นไวรัลทั่วอินเทอร์เน็ตนั่นเอง

ภาพจาก : https://thinglabs.io/how-to-use-dall-e-3

ที่มาของชื่อ "DALL-E" เกิดจากการผสานกันของชื่อศิลปินเซอร์เรียลชื่อดัง ซัลวาดอร์ ดาลี (Salvador Dalí) กับหุ่นยนต์ในภาพยนตร์ของดิสนีย์ "วอลล์-อี" (Wall-E) สะท้อนถึงเป้าหมายของเทคโนโลยีนี้ที่ต้องการรวมความเป็นศิลปะ และปัญญาประดิษฐ์เข้าไว้ด้วยกัน ทำให้ได้ภาพที่เต็มไปด้วยความคิดสร้างสรรค์ และอารมณ์ที่แฝงไปในภาพ

ภาพจาก : https://www.ankursnewsletter.com/p/openais-dall-e-2-converts-text-from

ประวัติความเป็นมาของ DALL-E (History of DALL-E)

DALL-E มีจุดเริ่มต้นจากโปรเจค Image GPT ในปี 2020 (พ.ศ. 2563) โดย OpenAI ซึ่งเป็นการทดลองนำเทคโนโลยีเครือข่ายประสาท (Neural Network) มาสร้างภาพจากข้อความที่มีคุณภาพสูง การเปิดตัว DALL-E ในเดือนมกราคม ค.ศ. 2021 (พ.ศ. 2564) ถือเป็นการพัฒนาต่อยอดจาก Image GPT ผสานความสามารถของ GPT-3 ในการเข้าใจภาษา และแปลงคำบรรยายสั้น ๆ ให้กลายเป็นภาพที่ซับซ้อน ซึ่งสร้างปรากฏการณ์ใหม่ในการสร้างภาพดิจิทัลที่สมจริง

จากความสำเร็จในรุ่นแรก OpenAI ได้เปิดตัว DALL-E 2 ในเดือนเมษายน ค.ศ. 2022 (พ.ศ. 2565) ซึ่งได้รับการพัฒนาให้สามารถสร้างภาพที่สมจริงยิ่งขึ้น และรองรับความละเอียดสูง สามารถผสมผสาน แนวคิด, คุณลักษณะ และสไตล์ต่าง ๆ ของภาพเข้าด้วยกันได้อย่างน่าทึ่ง ในเดือนกรกฎาคมปีเดียวกัน DALL-E 2 เริ่มเข้าสู่ช่วงทดลองใช้แบบเบต้า โดยให้สิทธิ์ผู้ใช้งานที่อยู่ในลิสต์ที่ลงทะเบียนรอไว้จำนวน 1 ล้านคนได้ใช้ เพื่อสร้างภาพจำนวนหนึ่งฟรีในแต่ละเดือน และในเดือนกันยายน ค.ศ. 2022 (พ.ศ. 2565) OpenAI ได้เปิดให้ทุกคนเข้าถึง DALL-E 2 ได้อย่างเสรี และไม่มีข้อกำหนดในการลงทะเบียนอีกต่อไป

ภาพจาก : https://zapier.com/blog/how-to-use-dall-e-2/

ในเดือนกันยายน ค.ศ. 2023 (พ.ศ. 2566) OpenAI ได้เปิดตัว DALL-E 3 ซึ่งเป็นเวอร์ชันล่าสุดที่ได้รับการพัฒนาให้มีความสามารถในการเข้าใจความหมาย และรายละเอียดของคำสั่งผู้ใช้งานได้ดีขึ้น ในช่วงต้นเดือนพฤศจิกายน ค.ศ. 2022 (พ.ศ. 2565) OpenAI ได้เปิดตัว API สำหรับ DALL-E 2 ให้กับนักพัฒนาทั่วไป เพื่อนำไปใช้งานในแอปพลิเคชันของตนเอง

และทาง Microsoft เองก็ได้ร่วมใช้ DALL-E 2 ในแอป Designer และเครื่องมือสร้างภาพ (Image Creator) ใน Bing และ Microsoft Edge ซึ่งการใช้งานผ่าน ส่วนต่อประสานโปรแกรมประยุกต์ (API) คิดค่าใช้จ่ายตามจำนวนภาพ และความละเอียด ซึ่งมีส่วนลดพิเศษสำหรับองค์กรที่ทำงานร่วมกับทีม OpenAI

ภาพจาก : https://www.artificialintelligence-news.com/news/openai-reveals-dall-e-3-text-to-image-model/

สุดท้ายในเดือนกุมภาพันธ์ ค.ศ. 2024 (พ.ศ. 2567) OpenAI เริ่มเพิ่มลายน้ำ และ Meta Data ตามมาตรฐาน C2PA ในภาพที่สร้างจาก DALL-E เพื่อให้ผู้ใช้งานทราบถึงแหล่งที่มาของภาพ และเป็นไปตามหลักจริยธรรมในการใช้งาน AI หรือ AI Literacy

DALL-E ทำงานอย่างไร ? (How does DALL-E Work ?)

วิธีการทำงานนั้น DALL-E จะสร้างภาพจากข้อความโดยอาศัยเทคโนโลยีหลักหลาย ๆ อย่าง รวมถึง การประมวลผลภาษาธรรมชาติ (NLP), โมเดลภาษาใหญ่ (LLM) และการประมวลผลแบบดิฟฟิวชัน (Diffusion Processing) การสร้างข้อมูลใหม่โดยอาศัยกระบวนการแพร่กระจาย เช่น Random Noise

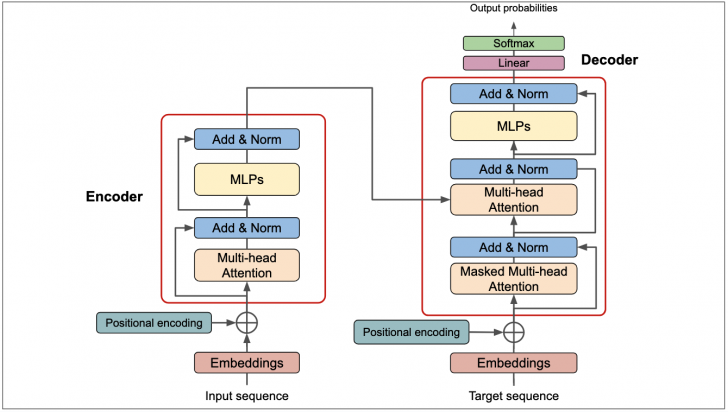

ใน DALL-E รุ่นแรกพัฒนาขึ้นจากส่วนหนึ่งของโมเดล GPT-3 แต่ใช้เพียง 12 พันล้านพารามิเตอร์ จากทั้งหมด 175 พันล้านพารามิเตอร์ใน GPT-3 ซึ่งเพียงพอสำหรับออกแบบให้เหมาะสมกับการสร้างภาพโดยเฉพาะ โดยโมเดลนี้ใช้เครือข่ายประสาทแบบทรานส์ฟอร์เมอร์ (Transformer Neural Network) ช่วยให้สามารถเชื่อมโยงแนวคิดต่าง ๆ เข้าไว้ด้วยกันอย่างมีประสิทธิภาพ

ภาพจาก : https://deeprevision.github.io/posts/001-transformer/

เทคนิค Zero-Shot Text-to-Image Generation ที่ใช้ใน DALL-E ช่วยให้โมเดลสร้างภาพใหม่ได้จากคำบรรยาย โดยไม่ต้องฝึกฝนกับภาพนั้นโดยตรง โมเดลสามารถใช้ความรู้ที่เคยเรียนมา เชื่อมโยงข้อมูลต่าง ๆ เข้าด้วยกัน เพื่อสร้างภาพที่ตรงกับคำสั่งใหม่ ๆ ได้อย่างแม่นยำ

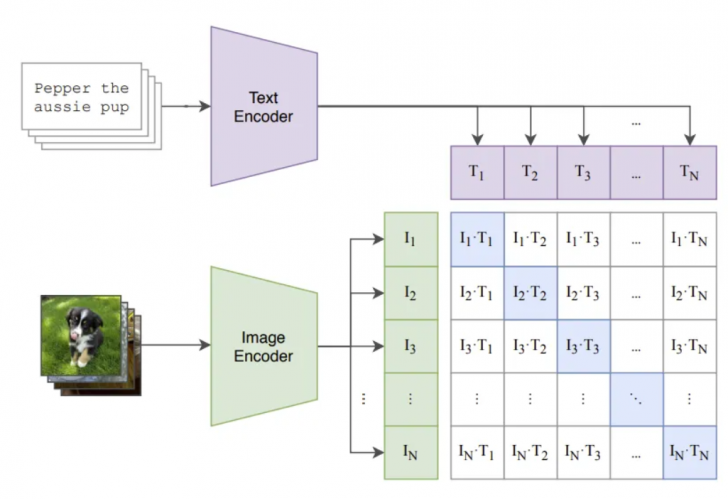

เพื่อประเมินความแม่นยำในการสร้างภาพ OpenAI ได้พัฒนาโมเดลที่เรียกว่า CLIP (Contrastive Language-Image Pre-training) ซึ่งผ่านการฝึกด้วยภาพที่ติดป้ายกำกับกว่า 400 ล้านภาพ โมเดล CLIP จะช่วยตรวจสอบ และเลือกแคปชันที่สอดคล้องกับภาพที่ DALL-E สร้างขึ้น เพื่อให้แน่ใจว่าภาพและข้อความมีความสอดคล้องกัน

ภาพจาก : https://medium.com/@sthanikamsanthosh1994/contrastive-language-image-pre-training-clip-connecting-text-to-image-d9ef92462eda

และใน DALL-E รุ่นแรก มีการใช้เทคโนโลยี Discrete Variational Autoencoder (dVAE) ซึ่งช่วยให้โมเดลแปลงข้อมูลคำบรรยายให้กลายเป็นภาพที่แม่นยำ และสอดคล้องกับความหมาย dVAE ได้รับแรงบันดาลใจจากงานวิจัยของ DeepMind ซึ่งพัฒนา Vector Quantized Variational Autoencoder (VQ-VAE) ขึ้นมา

เทคนิคนี้ช่วยให้โมเดลสามารถเข้ารหัสข้อมูลภาพให้อยู่ในรูปแบบที่เรียบง่าย และมีโครงสร้าง เช่น เมื่อเราป้อนคำบรรยาย “แมวนอนอยู่บนโซฟาสีแดง” ระบบ dVAE จะเข้ารหัสข้อมูลภาพ โดยแยกองค์ประกอบสำคัญออก เช่น รูปร่างของแมว และสีของโซฟา จากนั้นจะนำข้อมูลเหล่านี้มาเชื่อมโยงกันเพื่อสร้างภาพที่มีรายละเอียดตามคำบรรยาย ด้วยเทคนิค dVAE นี้ ทำให้ DALL-E สามารถสร้างภาพที่ดูสมจริงและแม่นยำ แม้โมเดลจะไม่ได้รับการฝึกฝนกับภาพนี้โดยตรง

(AI Genrated Image)

ข้อดี และข้อสังเกตของ DALL-E (DALL-E Pros and Cons)

มาถึงหัวข้อนี้กัน จากที่เราได้รู้จักกับ DALL-E และการทำงานของมันไป ทีนี้เรามาดูกันว่ามันมีข้อดี และข้อสังเกตอย่างไรบ้าง ?

ข้อดี

- ความรวดเร็ว : สามารถสร้างภาพคุณภาพสูงในเวลาอันสั้น เพียงไม่กี่วินาทีจากคำบรรยายเดียว

- ปรับแต่งอิสระ : สามารถสร้างภาพที่ปรับแต่งได้ตามจินตนาการ

- เข้าถึงง่าย : ใช้งานได้โดยไม่ต้องมีความรู้ด้านโปรแกรม ใช้ภาษาในชีวิตประจำวันผ่าน ChatGPT

- ปรับปรุงภาพ : สามารถปรับแต่งภาพได้อย่างต่อเนื่องในเซสชั่น (Session) เดิม

- ความยืดหยุ่น : วิเคราะห์ และสร้างภาพใหม่จากภาพที่ผู้ใช้อัปโหลดได้ เพื่อให้ได้ภาพที่ตอบโจทย์ที่สุด

ข้อสังเกต

- ลิขสิทธิ์ : แม้ OpenAI จะพยายามแก้ปัญหาเรื่องลิขสิทธิ์ แต่ความชัดเจนในด้านนี้ยังคงเป็นที่ถกเถียงอยู่

- ความน่าเชื่อถือ : งานศิลปะจาก AI ยังคงมีข้อกังขาในแง่ของความถูกต้องทางจริยธรรม และการแทนที่มนุษย์

- ข้อมูลพื้นฐาน : แม้จะฝึกด้วยข้อมูลขนาดใหญ่ แต่ DALL-E อาจยังขาดข้อมูลบางด้าน ทำให้บางครั้งสร้างภาพที่ไม่ตรงกับคำบรรยายได้

- ความสมจริง : แม้คุณภาพของภาพจะพัฒนาขึ้น แต่บางภาพอาจดูไม่สมจริงพอ

- ความชัดเจนของคำบรรยาย : คำบรรยายที่ไม่เจาะจงอาจทำให้ภาพไม่ตรงตามต้องการ และการปรับแต่งเพิ่มเติมอาจไม่ได้ผลลัพธ์ตามที่คาด

ตัวอย่างการนำ DALL-E ไปใช้งาน (Usage Examples of DALL-E)

เป็นแรงบันดาลใจสำหรับงานสร้างสรรค์

DALL-E สามารถจุดประกายแนวคิดใหม่ให้กับศิลปิน, นักออกแบบ และบุคคลทั่วไป ด้วยความสามารถในการสร้างภาพจากคำบรรยายเพียงสั้น ๆ ผู้ใช้งานจึงสามารถใช้ DALL-E เพื่อขยายขอบเขตของจินตนาการ และสร้างผลงานที่แปลกใหม่ไม่ซ้ำใคร

ด้านความบันเทิง

ภาพที่สร้างโดย DALL-E ถูกนำไปใช้ในสื่อต่าง ๆ เช่น หนังสือ, เกม หรือแม้กระทั่งงานนำเสนอ ด้วยการใช้คำบรรยายเพียงไม่กี่คำ DALL-E ก็สามารถสร้างกราฟิกที่มีความสมจริง หรือสร้างภาพที่แปลกใหม่ซึ่งอาจยากต่อการสร้างด้วยวิธีดั้งเดิม นับเป็นเครื่องมือที่ช่วยเพิ่มมิติใหม่ให้กับงานในวงการบันเทิงได้เป็นอย่างดี

การศึกษา

DALL-E มีบทบาทในการช่วยเหลือครูผู้สอน ในการสร้างภาพประกอบที่ซับซ้อนให้เข้าใจง่ายขึ้น ซึ่งช่วยเพิ่มความเข้าใจให้กับนักเรียน

การโฆษณา และการตลาด

เป็นอีกด้านหนึ่งที่ได้ประโยชน์อย่างมากจาก DALL-E ด้วยความสามารถในการสร้างภาพที่มีเอกลักษณ์ ทำให้การสื่อสารของแบรนด์นั้น ดึงดูดความสนใจของลูกค้าได้มากขึ้น

การออกแบบผลิตภัณฑ์

DALL-E ช่วยให้การสร้างภาพต้นแบบของแนวคิดใหม่ กลายเป็นเรื่องที่ง่าย และรวดเร็ว นักออกแบบสามารถนำภาพที่สร้างขึ้นมาใช้เป็นแนวคิดเบื้องต้นก่อนนำไปพัฒนาต่อ ซึ่งสะดวก และประหยัดเวลามากกว่าการใช้โปรแกรมออกแบบแบบดั้งเดิม

ซึ่งนี่ก็เป็นตัวอย่างการนำเอา DALL-E มาใช้งานคร่าว ๆ ซึ่งมันยังสามารถนำไปประยุกต์ใช้งานได้อีกมากมายแล้วแต่จินตนาการของเรา

บทสรุปเกี่ยวกับ DALL-E (DALL-E Conclusion)

สุดท้ายแล้ว DALL-E ก็คือเทคโนโลยี AI ที่สร้างภาพจากข้อความที่พัฒนาโดย OpenAI ใช้เทคนิค Deep Learning และโมเดลภาษา GPT-3 ทำให้มันสามารถสร้างภาพที่ซับซ้อนตามคำบรรยายได้อย่างสมจริง ตั้งแต่การใช้ในงานศิลปะ, การศึกษา, การโฆษณา, จนถึงการออกแบบผลิตภัณฑ์ ซึ่ง DALL-E ช่วยให้กระบวนการเหล่านี้ง่าย และรวดเร็วมากยิ่งขึ้น นับเป็นการพลิกโฉมวงการสร้างสรรค์ และสร้างแรงบันดาลใจใหม่ให้ผู้ใช้งานในทุกระดับ ...

ที่มา : www.techtarget.com , en.wikipedia.org

คำสำคัญ »

คำสำคัญ »

|

|

ทิปส์ไอทีที่เกี่ยวข้อง

แสดงความคิดเห็น

ซอฟต์แวร์

ซอฟต์แวร์ แอปพลิเคชันบนมือถือ

แอปพลิเคชันบนมือถือ เช็คความเร็วเน็ต (Speedtest)

เช็คความเร็วเน็ต (Speedtest) เช็คไอพี (Check IP)

เช็คไอพี (Check IP) เช็คเลขพัสดุ

เช็คเลขพัสดุ สุ่มออนไลน์

สุ่มออนไลน์